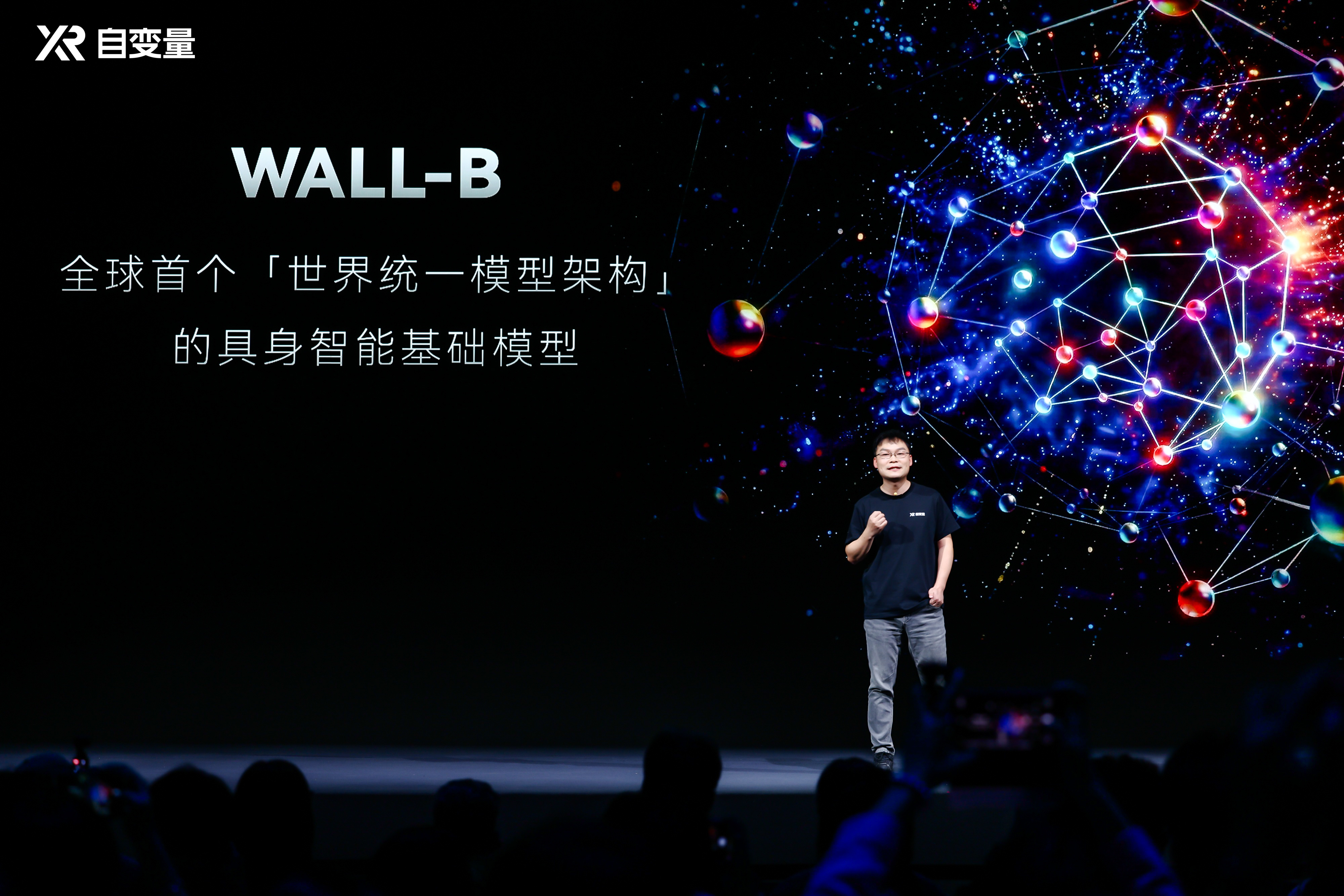

今天,自变量办了场发布会,公布了其自研具身智能基础模型 WALL-B 的一些细节,并宣布 35 天后搭载该模型的新一代机器人将首批入驻真实家庭。

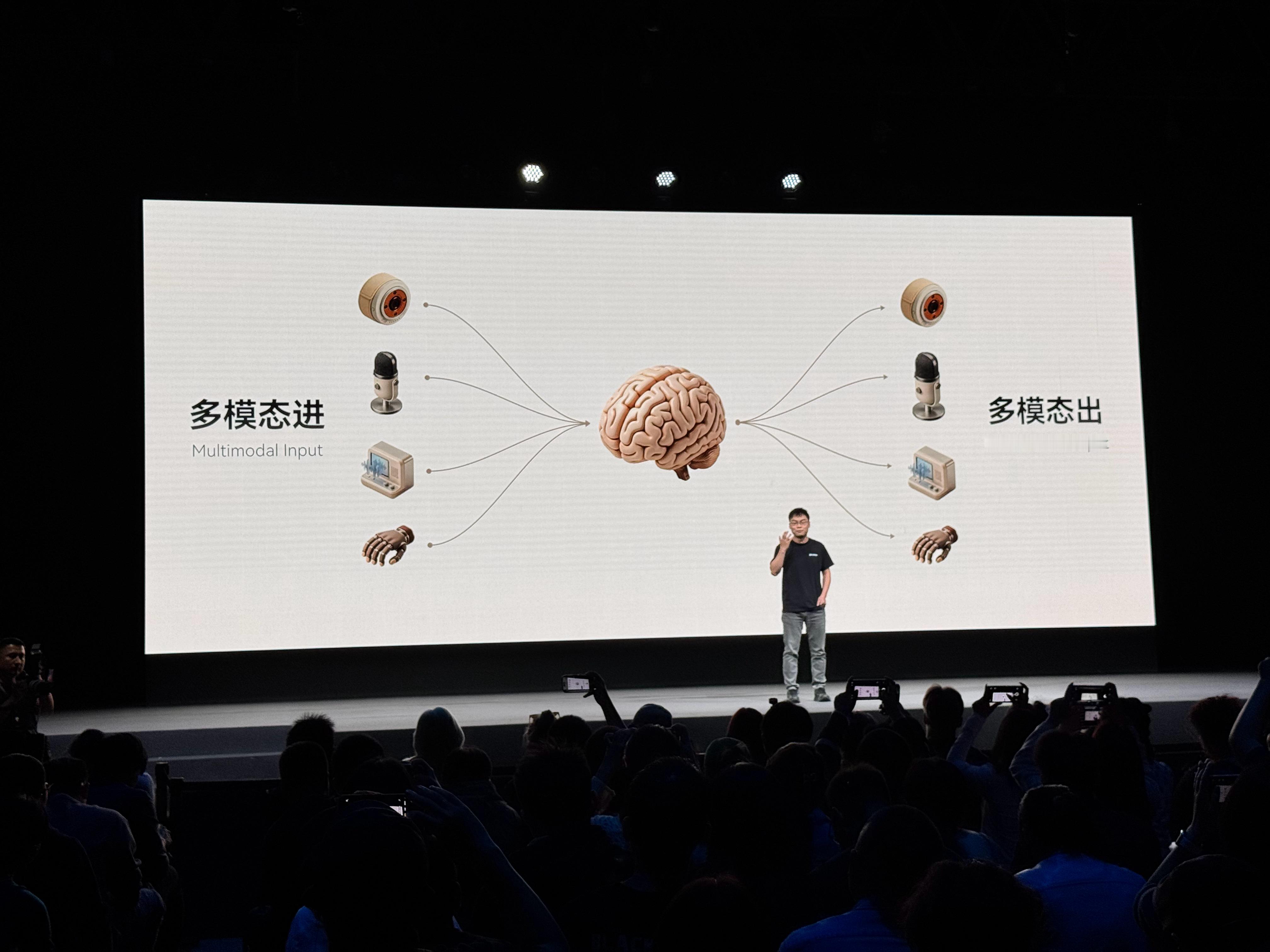

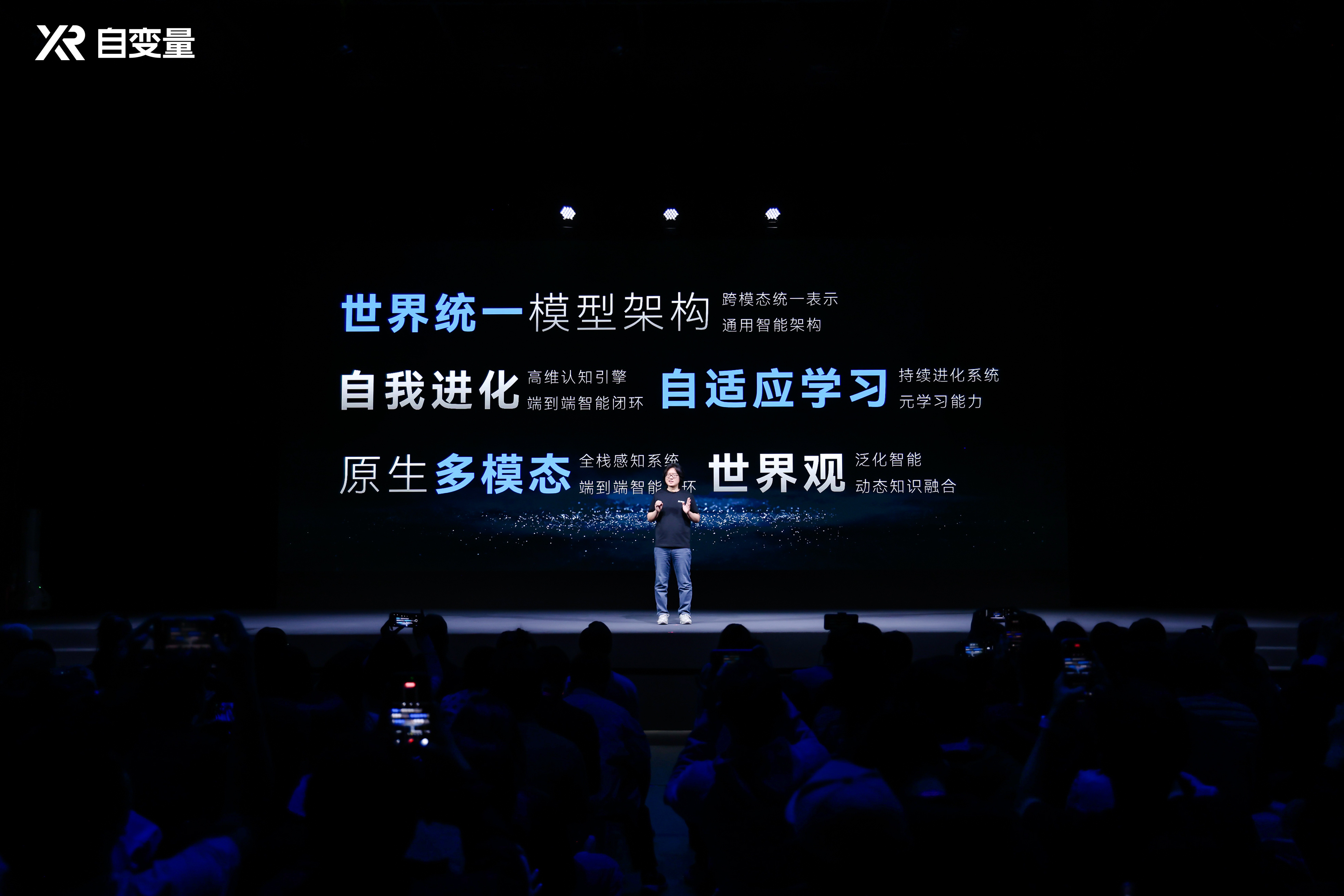

WALL-B 是一个世界统一模型(World Unified Model),它将视觉、语言、动作、物理预测等所有能力,放在同一个网络中从零开始联合训练,多模态进、多模态出。

它是原生多模态的。模型不需要在各个模块之间转译、传递,消除了模块间的边界和数据搬运损耗。

据自变量介绍,在这种原生多模态架构下,模型还获得了一种“原生本体感”的能力,可在不依赖大量外部传感器的情况下,内在地感知到自身的空间尺寸,例如高度、宽度、臂展范围等,这是一种内生的空间感知能力。

WALL-B 还能够感知并预测重力、惯性、摩擦力、速度等基本物理规律,这意味着它有更强的零样本泛化能力,可在一个陌生的环境中,利用自身对基本物理常识的理解来应对新场景。

VLA 在遇到问题时容易放弃,WALL-B 会在失败后调整策略继续尝试,成功后,则会总结经验,内化到模型能力中。

在数据方面,自变量采用实验数据打底,真实场景来提质,目前已进入到 100+ 个志愿者的家庭中,在真实家庭中获取数据。

为了进入到家庭,自变量在数据隐私方面给出以下解决方案:

- 视觉脱敏:机器人在设备端对原始图像进行实时打码,原始图像不离开设备,机器人看到的是去除个人特征的场景数据;- 透明授权:用户主动按下同意键后才能开机;- 用途限定:机器人只认 一个主人,发现可疑指令立即锁定。

首批用户申请地址:x2robot.com