中国出口token和电力赚钱这事说不通,但出口开源大模型是杀招

我很看不惯的一个事是,现在非常多人说中国在“出口token”,还说成出口电力赚钱,用电力优势赚token的钱。感觉都是对大模型token应用模式不太了解,一谈就是OpenRouter的调用量,中国大模型占了大部分。

电价在单Token成本中目前仅占约10%,这方面中国优势再大也意义不大。关键是,出口token根本赚不了多少钱。这得说下用token到底怎么回事,实际挺复杂的。

一般人用token,是在大模型APP、网页版上聊天。中国人用中国大模型APP,外国人用美国大模型APP,就算交了月费,也和出口没啥关系。和大模型聊天的人也不知道“输入1M收1元(缓存命中)、输出1M收24元”是啥意思,不会有“token费用在燃烧”的感觉,最多就是卡顿没回答。

开发者,用API调用大模型,这个就是token计费了,经常跑一个行务就烧光了钱,非常心疼。

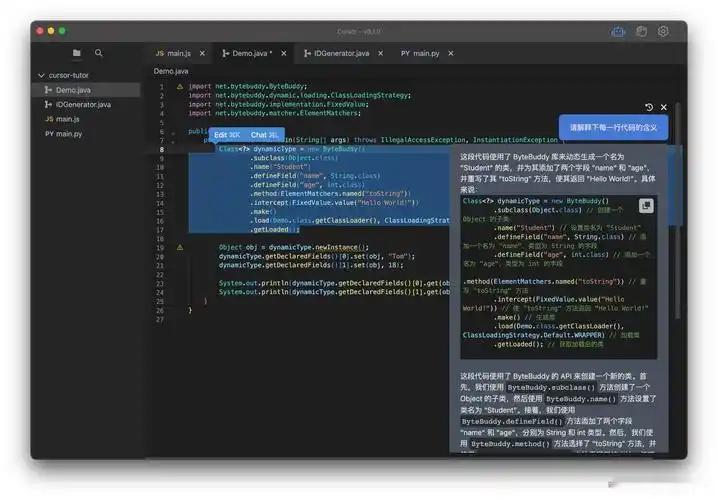

编程用Token有几道工具,首先就是编程IDE,非常多种。例如VS Code,原本就非常多人用来编传统程序,大模型出来以后,就开发了“AI插件”,里面就可以接入各类大模型了。还有“AI原生IDE”,是大模型出来以后专门开发的编程IDE,不是插件模式,最流行的是Cursor,但要20美元月费。字节的Trae也是AI原生IDE,免费。

编程IDE有了,还得选大模型,选择非常多,OpenAI, Anthropic, 智谱, DeepSeek。选择的大模型定了,只是算法定了。服务来源又分两类,一类是开发大模型的公司直接提供的,一类是第三方提供的,用开源大模型搭或者其它办法。而大模型运行跑的算力,有自己搭的,也有靠算力服务商的,是一种云服务。

这只是简单理解,实际还要复杂得多。第三方提供的大模型API服务就不简单。例如OpenRouter这个中国新闻整天提的,其实只是个需求转发平台,自己没有算力,只是赚个路由差价、平台费,市场份额只有3%。而亚马逊AWS Bedrock就自己有算力,真的部署了很多种大模型在上面跑。OpenAI和Anthropic有自己机器提供的算力赚钱,也有Bedrock上面跑的,但就是间接分成,这个收入算不算两家吵起来了。

第三方要把开源模型权重变成可用的API服务,这里面就很复杂,不是简单的傻瓜部署,要适配各种硬件算力。而且各种API调用级别不同,有企业级高并发推理,有散户聊天,推理部署是有学问的,面向个人用户的Ollama听过的人多些、还有vLLM/TGI/TensorRT-LLM,SGLang/LMDeploy一堆推理中间件。

如果OpenRouter上面用了中国大模型,是不是等于中国出口token了?也不是,要看这个大模型在哪跑的,可能是部署在美国、新加坡的数据中心。API调用token模式非常复杂,中国到底出口了多少token算不清,数量很少是可以肯定的。

唯一可以肯定的是,中国开源大模型的价格是真便宜,而这是杀招。不管在美国还是中国的硬件上跑,价格便宜是确定的。一旦中国开源大模型性能追平美国闭源大模型,竞争就结束了。那些燃烧token心疼的开发者,token调用必然转向便宜的来源。

因此,即使中国推理算力不足,只要开源大模型实力强劲,就能把美国大模型干掉。美国第三方公司会用美国算力,加上中国开源大模型权重,把这个事干成。中国大模型公司,把训练做到足够好就行了。