同样是在昨天,自变量机器人也举办了一场发布会,主题为一个家庭成员的诞生。

在发布会上自变量宣传完成近20亿元B轮融资,由小米战投领投,成为国内唯一同时获得字节、美团、阿里、小米四家互联网巨头投资的具身智能企业。

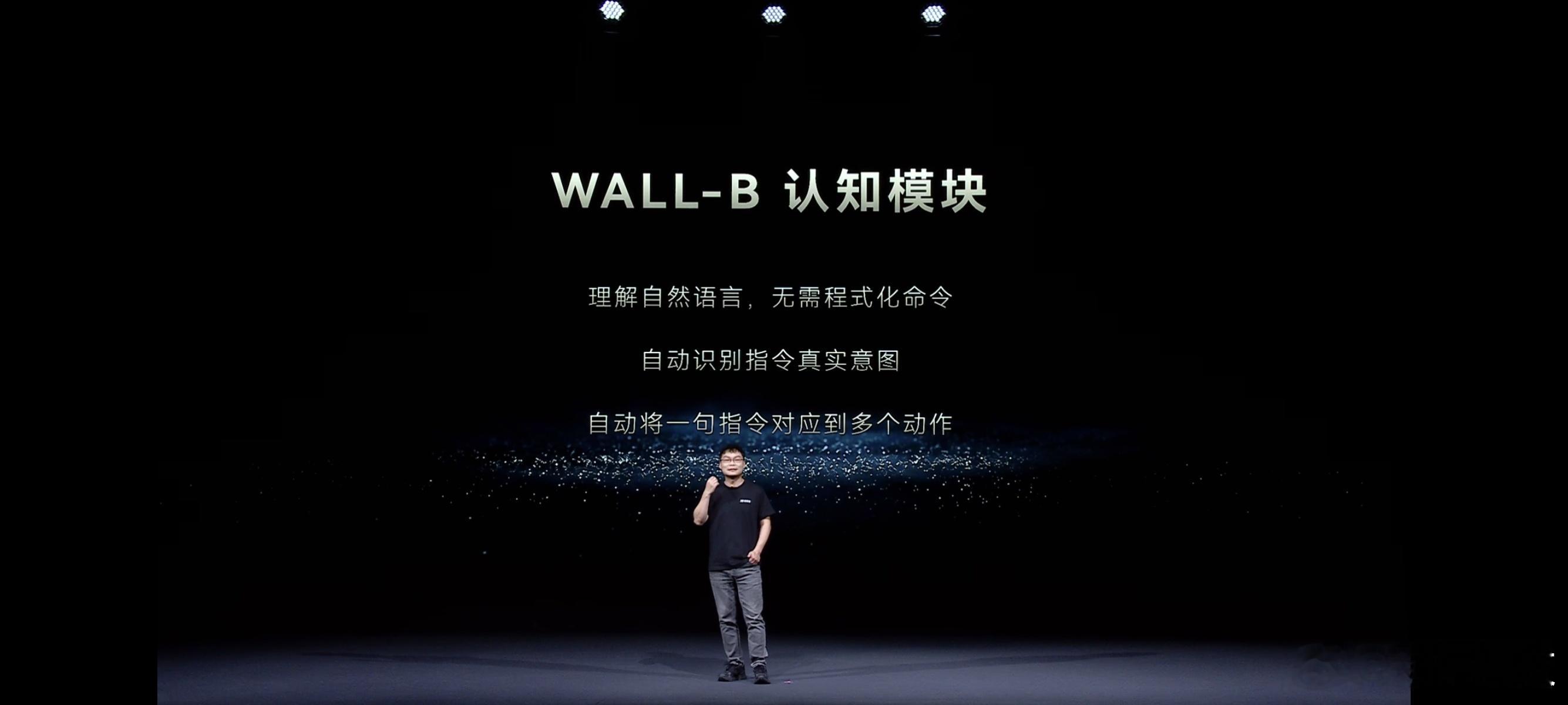

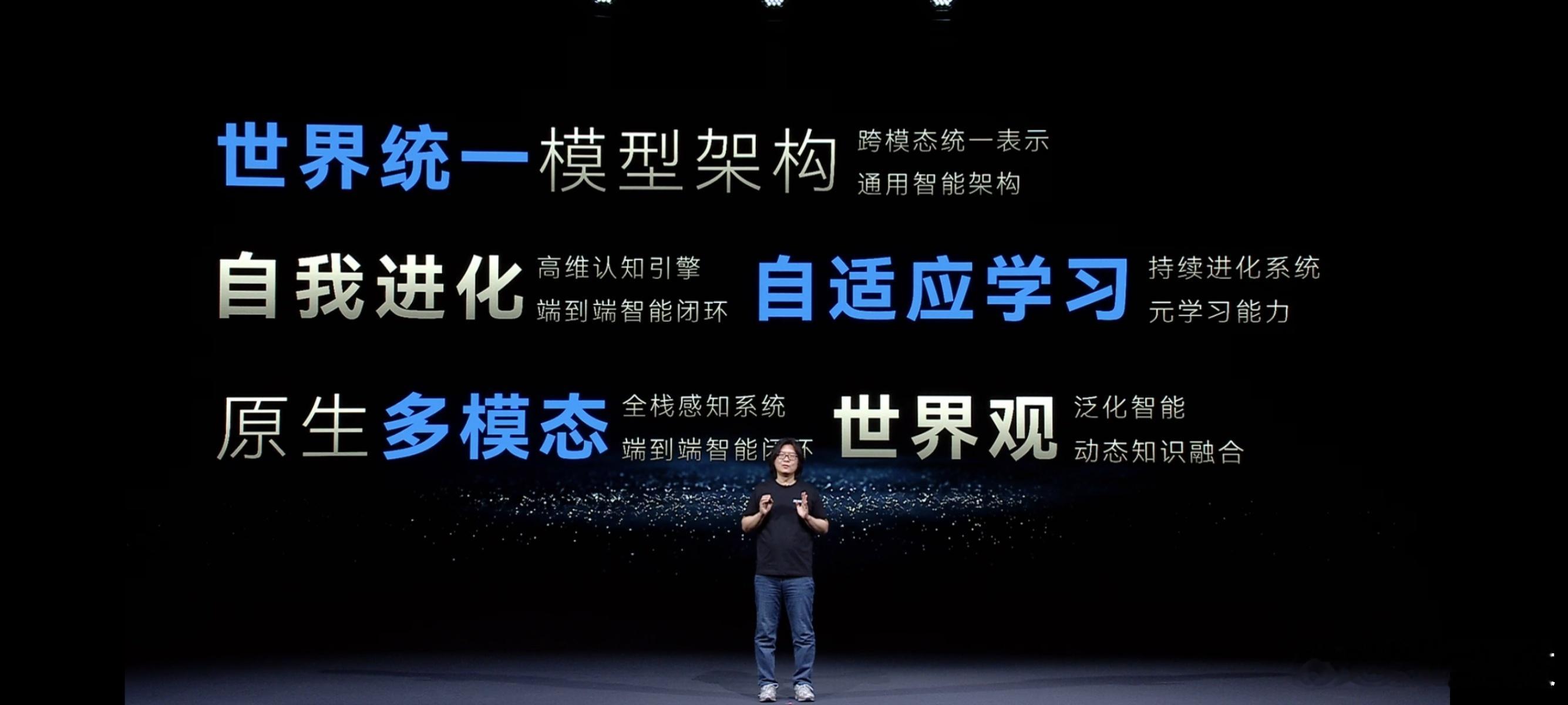

自变量正式发布新一代具身智能基础模型Wall-B。这是全球首个基于世界统一模型架构的具身智能基础模型,标志着具身基础模型从VLA架构向原生多模态融合架构的重大跨越。

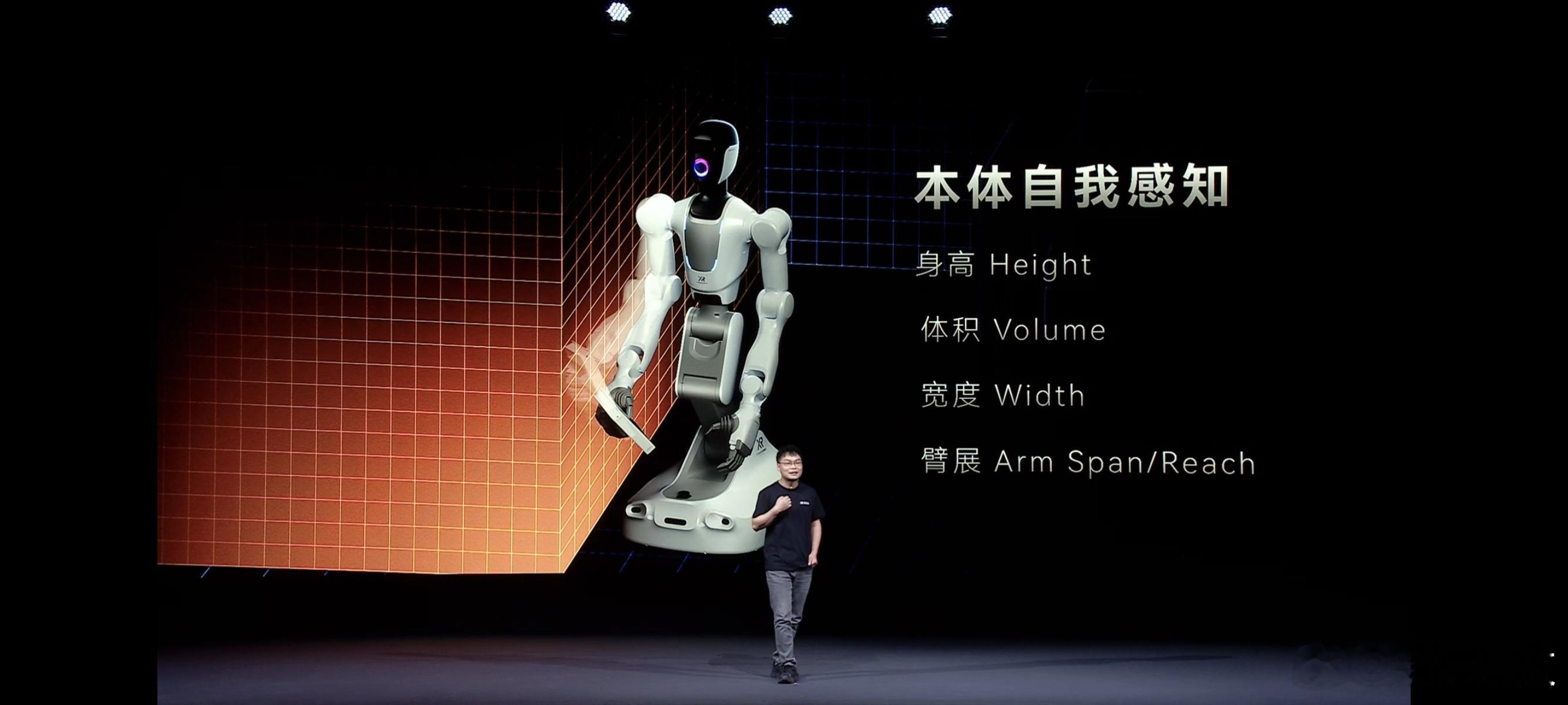

传统VLA(视觉-语言-动作)架构是三个独立模块拼接,数据在模块间逐级传递会产生信息损耗和延迟。Wall-B采用的WUM架构将视觉、语言、动作、物理预测等所有能力放在同一个网络中从零开始联合训练、融为一体,消除模块间的边界和数据搬运损耗,设计思路类似Apple Silicon的统一内存架构。行业内大多数训练数据来自实验室,被称为“糖水数据”,虽然干净可控但与真实世界差距显著。自变量团队进入了100多个真实家庭采集“牛奶数据”,即嘈杂、多变、充满随机性的真实环境数据,让模型学会在不确定环境中生存。现有机器人多为预设轨迹的“命令行机器人”(如后空翻、跳街舞),本质是炫技表演。自变量将具身智能从“舞台表演”拉进“真实生活”。把行业里遥操、糖水数据等“没人敢说的事全摆出来讲”,保持克制与诚实,不夸大当前能力,明确将机器人定位为“家庭实习生”。

隐私保护上自变量将会采取视觉脱敏(设备端实时打码,原始图像不离开设备)、透明授权(用户主动按下同意键后方可开机)以及用途限定(绝不共享第三方,发现可疑指令立即锁定)三重保护措施。自变量计划在5月25日将部署Wall-B的新一代机器人入驻真实家庭,招募首批“机器人家长”共同测试迭代。目前机器人定位为“实习生”,会犯错、需要远程协助,但能24小时在岗,并每天因新数据变得更聪明。 一个家庭成员的诞生 自变量421发布会 具身智能