车是最先落地的具身智能刚看完微博科技最新一期的《科技漫谈》,这次对话的是小米智能驾驶基座大模型负责人陈龙,很有意思。

首先大伙得明白什么是具身智能,简单来说就是给AI一个“身体”,然后它能通过感知-决策-行动-反馈这套逻辑持续与现实世界进行交互,在交互中学习、适应并完成复杂任务。

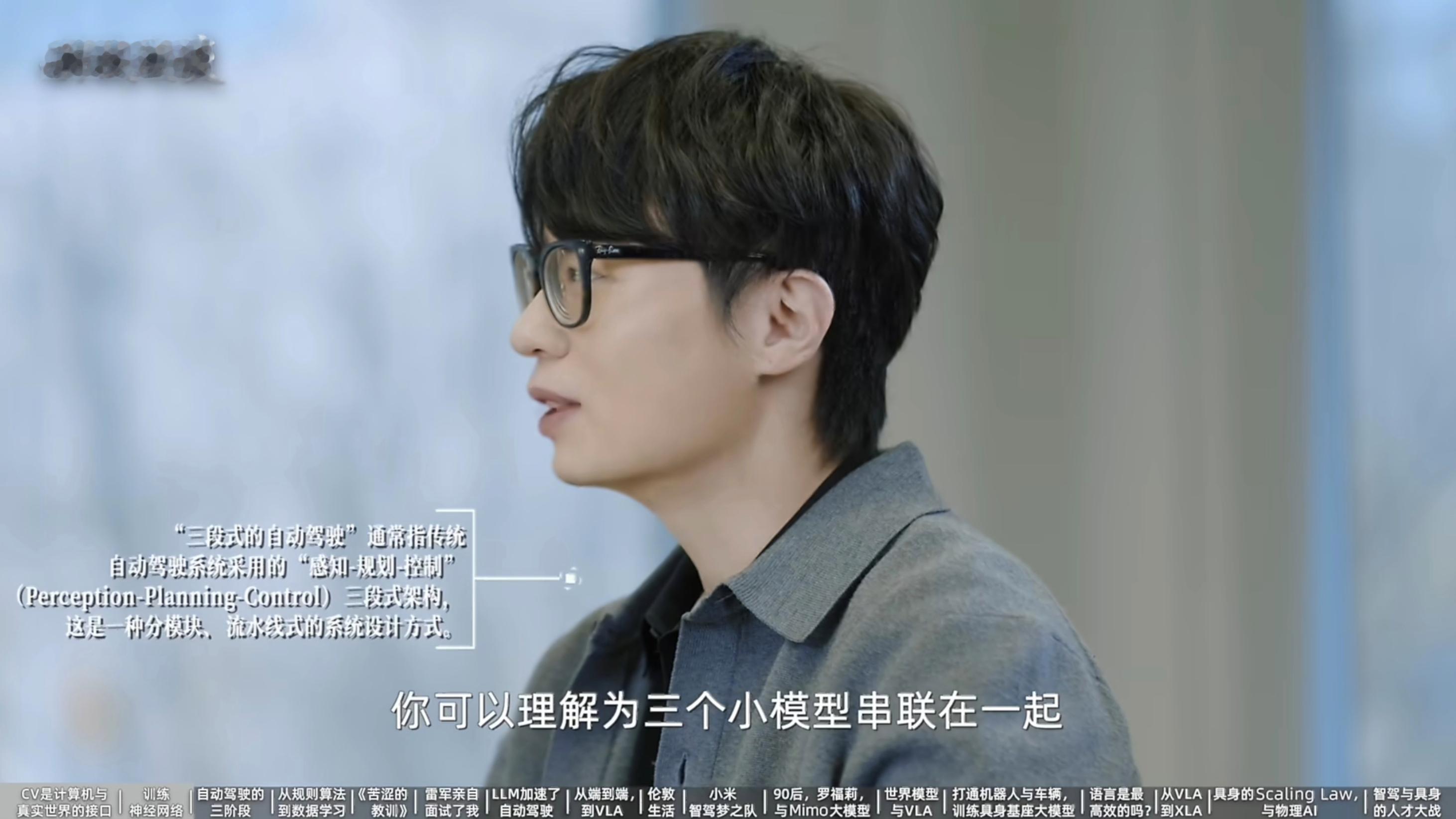

所以汽车也是AI的一种物理载体,并且应该是最先真正落到我们生活里的具身智能,因为现在很多主流车企的辅助驾驶基本上都是VLA模型,这套模型的基本逻辑就是将视觉感知、语言推理、动作控制融合进一个模型里,这样它就能像人一样理解交通场景的语义、预判风险、灵活应对突发情况,甚至能听懂你的自然语言指令并执行。

而且各家还对这套逻辑进行了优化,比如小米的XLA模型,则是在VLA的基础上扩展了激光雷达、导航等多模态输入,并且与机器人MiMo-Embodied打通,机器人的精细操作经验可以提升汽车的空间感知能力,而汽车的海量驾驶数据也能让机器人更聪明。

还有小鹏的第二代VLA,则是直接砍掉了“语言转译”这个中间环节,视觉与动作直链,纯视觉为主,雷达仅作安全冗余,有点类似于我们的条件反射,全链路延迟更低,并且由于是以视觉为主,所以在没有高精地图的情况下能力会更强。

总得来说,就是现在的辅助驾驶进步的非常快,从之前只能识别预设好的物体类别、没有语义理解能力,到现在车载大模型的自主学习,这个变化是非常快的,大伙感兴趣也可以去线下试试这些车企的辅助驾驶,亲身体验一下辅助驾驶的进步。