深度长文 RL Scaling Laws for LLMs -- Scaling laws 如何从预训练演进到强化学习地址:cameronrwolfe.substack.com/p/rl-scaling-laws

Scaling 是 AI 研究史上最有影响力的概念之一。对于大语言模型(LLM)而言,scaling 主要是在预训练语境下被研究的;在这一阶段,严谨的 scaling laws 让我们能够清晰定义算力与性能之间的关系。受这些可预测趋势的启发,LLM 研究社区已经在多个数量级上对预训练 scaling laws 进行了经验验证。在这一过程中,我们发现,只要向预训练投入更多数据和算力,模型能力通常可以持续获得有意义的提升。

“过去机器学习的方式是,人们只是不断调试各种东西,试图得到有趣的结果。这就是过去一直在发生的事情。后来,scaling insight 出现了。Scaling laws、GPT-3 出现后,所有人突然意识到:我们应该扩大规模。这是语言如何影响思维的一个例子。Scaling 只是一个词,但它是一个如此强大的词,因为它告诉人们该做什么。”—— Ilya Sutskever

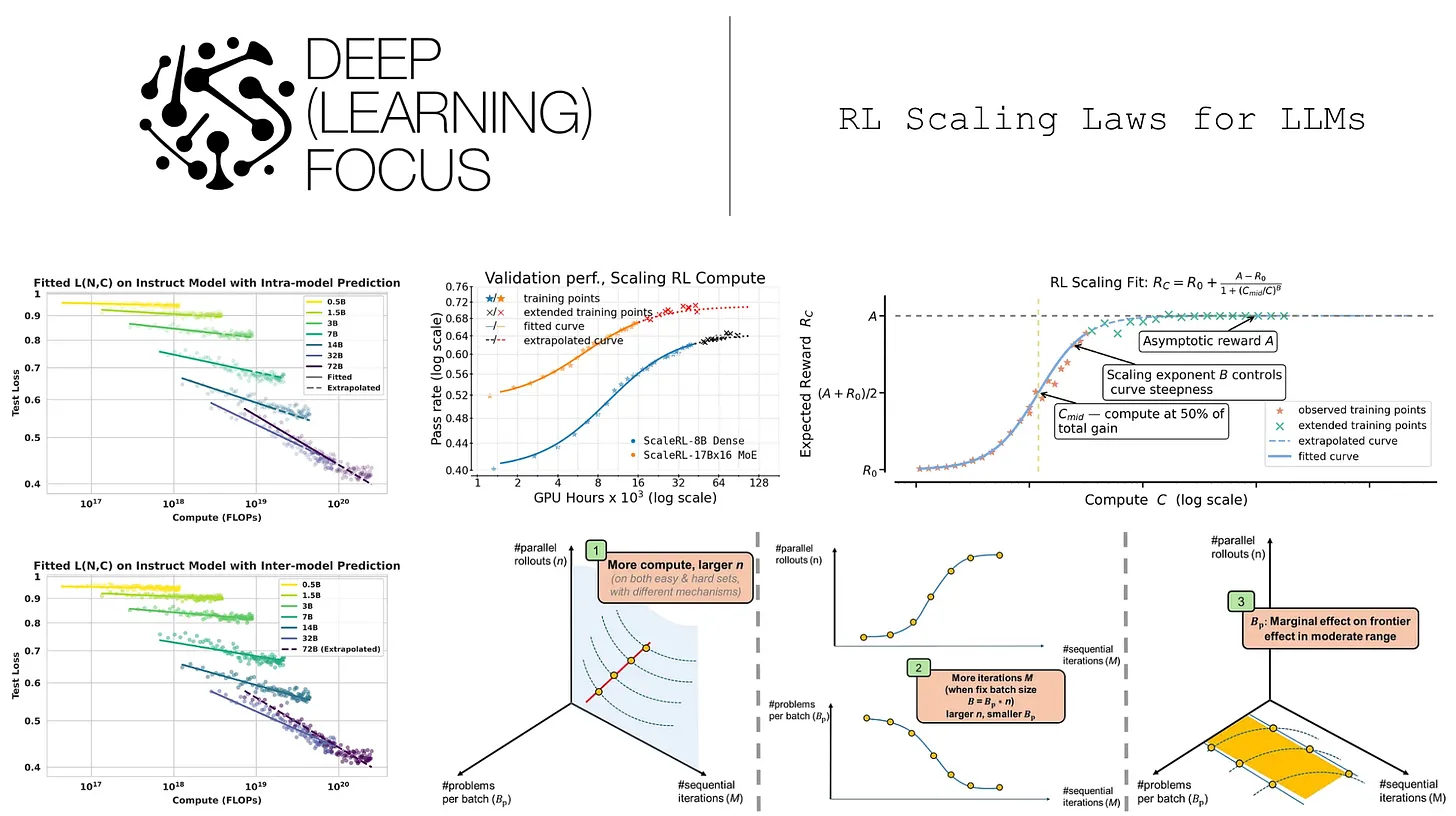

Scaling laws 在预训练中的成功,启发研究者将同样的 scaling 概念应用到 LLM 训练流程的其他环节。最显著的是,scaling 如今在强化学习(RL)中也扮演着关键角色;研究者已经证明,更大规模的训练可以带来平滑且可预测的模型能力提升。在这篇综述中,我们将研究 RL 语境下的 scaling laws。为了建立更完整的理解,我们会先深入讨论预训练中的 scaling laws,并梳理 scaling laws 如何逐步演进到 RL 应用中。正如我们将看到的,scaling laws 在这两个领域中的具体定义完全不同,但“规模”这一基础概念在二者中依然同样强大。

AI创造营How I AI