AI芯片界的“双雄对决”从未停止!英伟达GPU凭一己之力垄断市场,成为所有科技公司疯抢的“屠龙刀”,十年间让投资者赚得盆满钵满,而谷歌偏不跟风,15个月快速打造出初代TPU,十年迭代升级,铸就了一把能与英伟达GPU抗衡的“倚天剑”TPU,在AI特定任务上形成性能优势,却沉寂多年,如今竟被Meta、苹果疯抢。

在AI浪潮中,算力就是“话语权”,而英伟达GPU之所以能垄断市场,核心在于它的通用性和成熟的软件生态。GPU原本用于图形渲染,擅长并行运算,适配多种场景,再加上CUDA平台经营数十年,全世界的工程师都习惯了用它开发,就像行业“普通话”,上手容易、生态完善,这让英伟达坐稳了“卖铲子”的宝座。

但谷歌却看透了其中的隐患:依赖外部芯片,终究会被卡脖子,而且通用架构的GPU,在AI核心运算上效率不高,长期使用成本会指数级增长。于是,谷歌决定“另起炉灶”,自研专用AI芯片TPU,走差异化路线。与GPU的“全能”不同,TPU从诞生起就只专注于AI最核心的矩阵乘法运算,这种“术业有专攻”的设计,让它在AI任务上实现了针对性优势。

TPU的核心优势,在于其独特的“脉动阵列”设计。传统CPU运算时,每算一步都要反复访问内存,效率低下;而TPU的运算单元像一条同步运转的生产线,数据层层传递、接力运算,无需频繁切换内存,几乎没有空转,这让它的能效比远超GPU。

初代TPU在推理任务上的表现就惊艳全场,比同期的英伟达K80GPU快15—30倍,能效比高出30—80倍,用实力证明了专用架构的价值。

但TPU为何没能像GPU一样普及?核心有两个原因。一是谷歌的封闭策略,TPU最初只是谷歌内部使用的“专属武器”,不对外售卖,就像藏经阁里的秘籍,别人只知其强,却无法触及;即便后来逐步开放云端售卖,开放程度和获取难度也远高于GPU。

二是软件生态的差距,TPU的编译器XLA操作复杂、编译开销大,上手门槛极高,不像CUDA那样亲民,对于初创公司来说,迭代效率远不如使用GPU。

更严峻的是,英伟达也在“抄作业”,2025年12月与TPU早期成员创办的AI芯片公司Groq达成非独家技术授权协议,将其低延迟处理器技术整合至自身“AI工厂”架构,以拓展AI推理和低延迟应用场景。

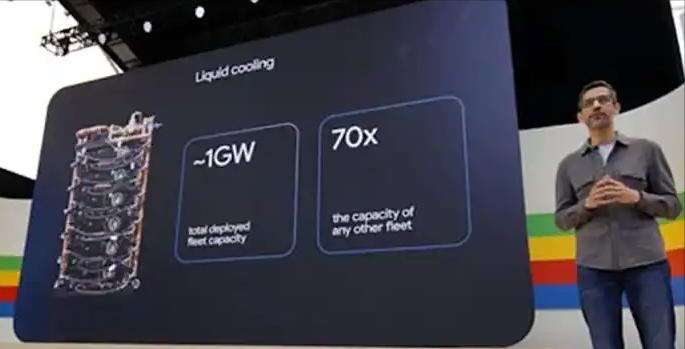

就在所有人以为英伟达会一统江湖时,局势发生了反转:Meta、苹果等巨头纷纷转向TPU,博通则深化与谷歌的长期合作,为其供应TPU芯片和网络组件,这些举措并非因为信仰谷歌,而是为了摆脱对英伟达的依赖,在AI浪潮中掌握主动权。

如今的AI芯片江湖,早已不是“一家独大”。谷歌TPU用十年时间,从“备胎项目”成长为能与英伟达GPU分庭抗礼的“利器”,背后是科技巨头对AI底层话语权的争夺。其实,不管是TPU还是GPU,最终受益的都是普通人——它们的竞争,会让AI算力更便宜、更稳定,让我们身边的AI应用越来越智能。这场博弈,没有绝对的赢家,但有绝对的进步。